Stable Diffusion WebUI AUTOMATIC1111のv1.6.0にアップデートされてリファイナー対応のSDXLに完全対応となりました。ここでは、SDXLをフルで使うためのWebUIのv1.6.0の使用方法をみていきます。

準備

WebUIでSDXLを使うためにはWebUIを最新のv1.6.0以上にアップデートする必要があります。アップデートの方法はこちらの記事をご確認ください。(リンク:Stable Diffusion WebUIのバージョン1.6.0のアップデートを試してみる)

WebUIのセットアップから行う方はこちらをご参照ください。

また、SDXLのモデルは以下からダウンロード可能です。

Checkpoint(stable-diffusion-webuiのmodelsの中のStable-diffusionフォルダに入れる)

sd_xl_base_1.0.safetensors(baseモデル)

sd_xl_refiner_1.0.safetensors(refinerモデル)

VAE(stable-diffusion-webuiのmodelsの中のVAEフォルダに入れる)

sdxl_vae.safetensors

もし、VRAMが12GB未満のGPUを使っている場合は通常の設定ではSDXL生成時にOutOfMemoryErrorが起こるので、起動時にクリックするstable-diffusion-webuiの中の「webui-user.bat」をシフト+右クリックで「編集」を選択して、テキストエディタで「set COMMANDLINE_ARGS=」の行に「–medvram-sdxl」を追記します。

以下に私が使っている「webui-user.bat」の設定内容を示します。

@echo off

set PYTHON=

set GIT=

set VENV_DIR=

set COMMANDLINE_ARGS= --no-half-vae --opt-channelslast --autolaunch --xformers --medvram-sdxl

call webui.bat

SDXLでの画像生成

それではSDXLの画像生成の基本設定をしてきます。

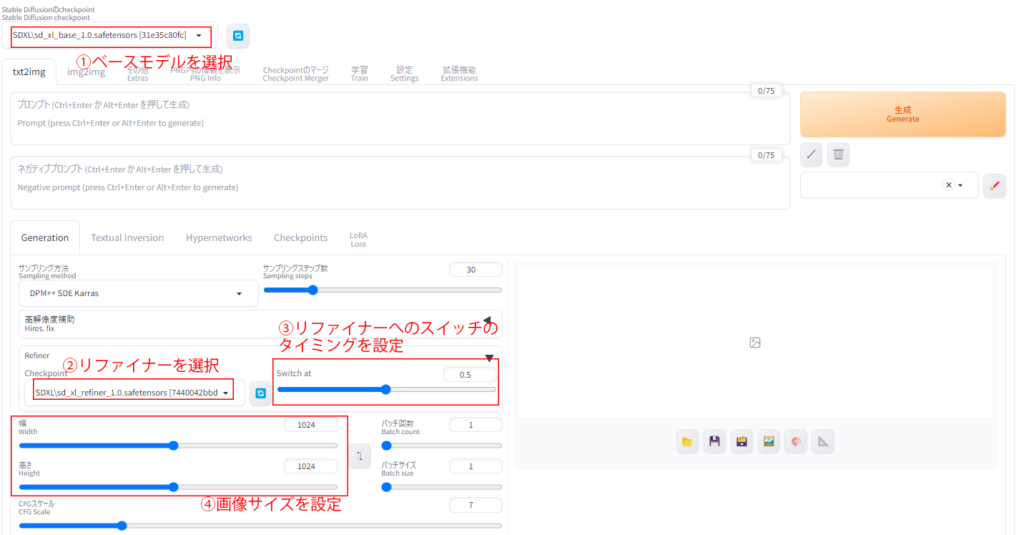

モデルの設定

まず、SDXLの公式モデルを使っていきます。ベースモデルに「sd_xl_base_1.0.safetensors」を、リファイナーに「sd_xl_refiner_1.0.safetensors」を選択します。「Switch steps」でベースモデルからリファイナーモデルに切り替えるステップを設定します。今回は総ステップ30のうち、50%の15ステップはベースモデル、残りの50%の15ステップでリファイナーモデルを適用します。後半にリファイナーモデルを適用することで、高品質な画像にすることができます。

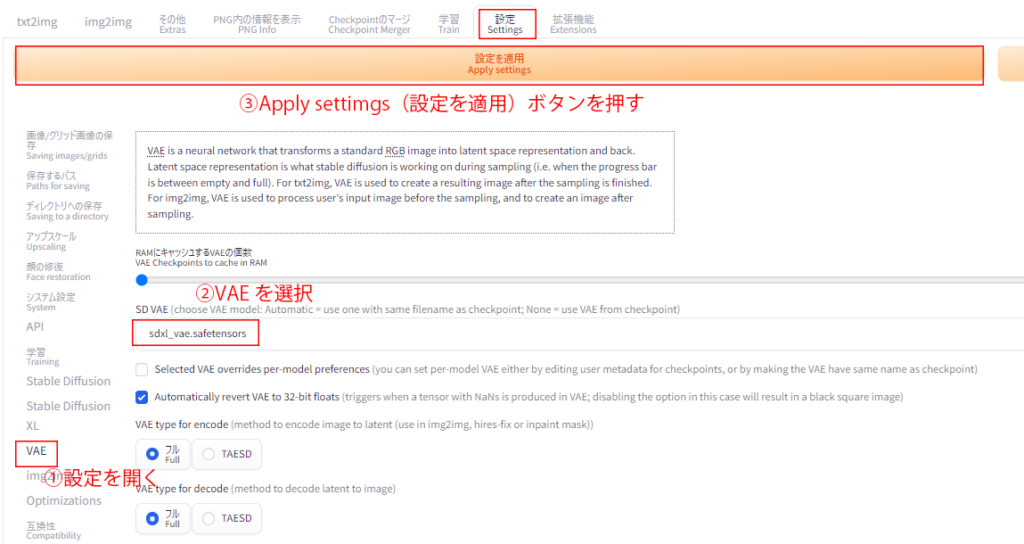

VAEはSettings(設定)で「VAE」を開いて、「sdxl_vae.safetensors」を選択し、「Apply settings」(設定を適用)のボタンを押します。

スタイルの設定

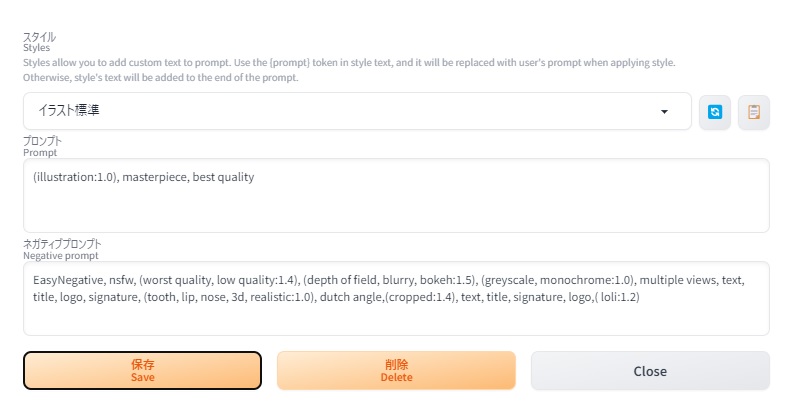

SDXLでの画像生成を行ってみます。v1.6.0になってスタイルエディターが実装されました。最初にスタイルの設定をしてみます。生成ボタンを押すとスタイルエディターが開きます。

スタイルエディターには画像共通の品質に関するプロンプトを入れます。今回はイラスト用のプロンプトを準備します。作成したスタイルを保存ボタンで保存します。

Style Prompt例

(illustration:1.0), masterpiece, best quality

Style Negative Prompt例

EasyNegative, nsfw, (worst quality, low quality:1.4), (depth of field, blurry, bokeh:1.5), (greyscale, monochrome:1.0), multiple views, text, title, logo, signature, (tooth, lip, nose, 3d, realistic:1.0), dutch angle,(cropped:1.4), text, title, signature, logo,( loli:1.2)

※上記のNegative PromptではEmbeddingsのEasyNegativeを使っています。使う場合は、EasyNegativeをダウンロードしてembeddingsのフォルダ内に入れてください。

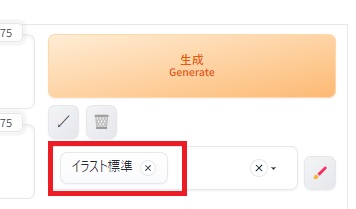

スタイルはリストから選択することで適用されます。これまでのバージョンとは適用のさせ方が違うので注意してください。

画像生成例

プロンプトを入力して画像を生成します。今回、リファイナーの効果を確認するために、baseモデルだけを30ステップ行った場合と、baseモデル15ステップとrefinerモデル15ステップ行った場合を比較します。

桜とウサギ

close up photo of a rabbit, forest, haze, halation, bloom, dramatic atmosphere, centred, rule of thirds, 200mm 1.4f macro shot

学校の建物を正面から

building, front, outdoor, trees, school, garden, baroque architecture, 3d

ロボット兵器

complex 3d render ultra detailed combat robot weapon, mobile suit, analog 150 mm lens, beautiful natural soft rim light, Beautiful metal luster, Mud stains, colorful details, cable wires, microchip, badass, hyper realistic, ultra detailed, octane render, mechanical gauge, volumetric lighting, 8k post-production, red and white with a bit of black, detailled metalic bones, semi human, iridescent colors, futuristic room, power of the god, high-angle shot, complex body poses

アニメ調の女性

1girl, solo, smile, pure face, ponytail, school uniform, looking at veiwer, flat chest, standing, outdoor, animation, CG graphics, cute face, highly detail, harajuku street

1girl,solo, rain, night city, anime style, close-up, an extremely delicate and beautiful

negative prompt umbrella

アニメ系のイラストを出すなら、CounterfeitXLやAnimagineXLなどのアニメ系の学習を強化したモデルを使った方が良いかもしれません。

コメント